Semantische Betriebsschicht für Concerto-Webshops – Google-SEO, Refurbished-Logik und LLM-Readiness in einem einzigen, clientseitigen System.

Zur Übersicht: Phoenix eComS – Schweizer E-Commerce, SEO & LLM Solutions

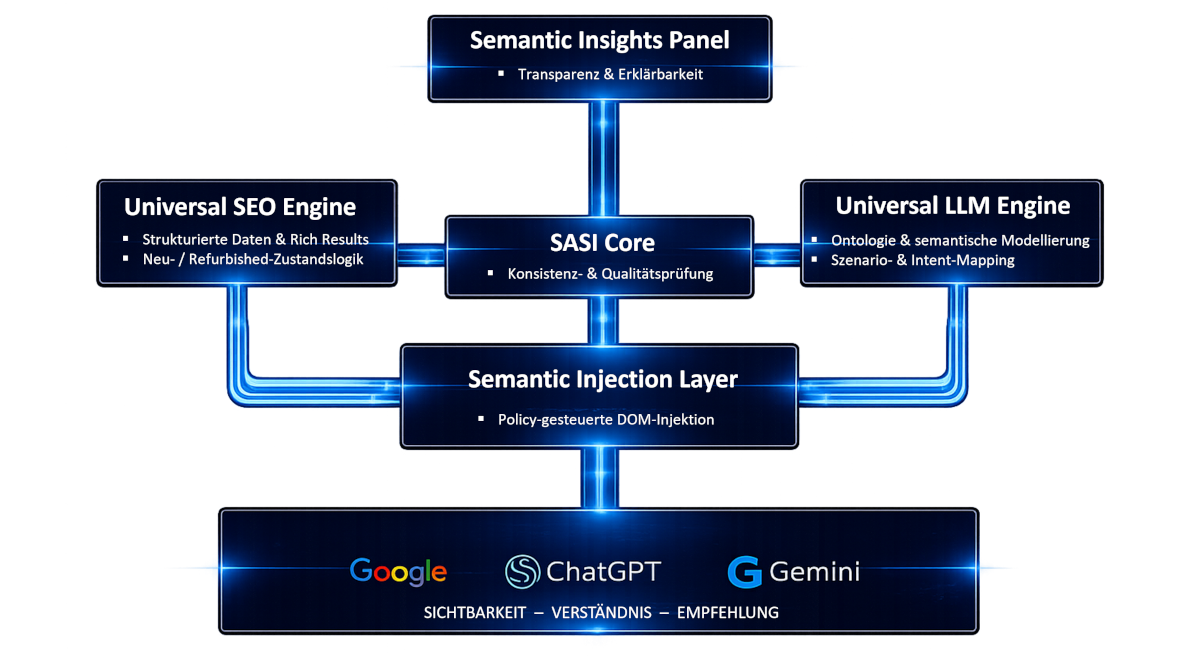

Die Phoenix Universal SEO & LLM Engine ist keine klassische SEO-Erweiterung, sondern eine semantische Infrastruktur-Schicht.

Sie optimiert Inhalte von Concerto-Webshops gezielt für zwei unterschiedliche, aber eng miteinander verbundene Zielsysteme:

Während herkömmliche SEO-Systeme primär Keywords und einzelne Seiten betrachten, arbeitet die Universal SEO & LLM Engine kontextuell, strukturiert und beziehungsorientiert. Inhalte werden nicht nur ausgezeichnet, sondern verstanden.

Konkreter Mehrwert für Webshop-Betreiber:

Kurz gesagt: Phoenix eComS & ProSeller sorgen in Kooperation dafür, dass Concerto-Webshops nicht nur gefunden – sondern von Suchmaschinen und KI-Systemen korrekt interpretiert, eingeordnet und bevorzugt ausgespielt werden können.

Was dieses System bewusst nicht ist:

Damit wird aus „SEO“ eine messbare, deterministische Infrastruktur – und aus „KI-Readiness“ ein prüfbarer Systemzustand statt ein Buzzword.

Die Universal SEO Engine erzeugt vollständig valide, konfliktfreie schema.org-Strukturen für Google. Sie erkennt den realen Seitentyp und injiziert ausschliesslich passende Schemas.

Preise, StrikePrice (UVP), Verfügbarkeit, Lieferzeiten sowie Neu- & Refurbished-Zustände werden realistisch und regelkonform abgebildet.

Zusätzlich: Schema-Sanitation – bestehende Product-/Offer-Markups werden entfernt, bevor die Engine publiziert. Ergebnis: keine Kollisionen, keine widersprüchlichen Rich Results.

Die Universal LLM Engine modelliert Inhalte so, dass sie von KI-Systemen inhaltlich verstanden werden.

Sie erzeugt ein eigenes, versionsstabiles LLMDocument mit Ontologie, Semantik, Glossary und Beziehungen – optimiert für ChatGPT, Gemini, Perplexity, Claude & kommende LLMs.

Entscheidend: Szenarien & Intents werden deterministisch aus dem ProductType abgeleitet – nicht aus Keyword-Raten.

Transparenz- & Kontrollschicht für Betreiber und Entwickler. Alle SEO-Schemas und LLM-Dokumente sind live einsehbar.

Page-Type, Produktzustand, Preise, Semantik und Relations

werden in Echtzeit visualisiert – sichtbar nur durch URL-Ergänzung:

?insights

Zusätzlich: Semantic Injection Status (injected / skipped) inkl. Begründung, basierend auf SASI-Policy und SIL-Entscheidung.

Die Phoenix Universal SEO & LLM Engine ist keine lose Script-Sammlung, sondern eine strikt orchestrierte Plattform. Jedes Modul hat eine klare Verantwortung – und eine definierte Reihenfolge. Genau dadurch entsteht Stabilität.

Der AI Master Loader ist der einzige Einstiegspunkt in produktiven Shops. Er lädt die gesamte Suite in exakt definierter Reihenfolge und ist timing-safe (NAS/Cloudflare-safe), idempotent und auditierbar.

Fixe Boot-Reihenfolge:

Ergebnis: keine Race Conditions, keine Teilzustände, keine “lädt manchmal”. Das System bleibt stabil – auch bei externen Includes und SPA-Navigation.

Suchmaschinen und LLMs reagieren empfindlich auf widersprüchliche Signale: Eine Seite, die mal als Produkt, mal als Kategorie, mal als Content interpretiert wird, erzeugt Instabilität.

Die Phoenix Universal SEO & LLM Engine vermeidet diese Instabilität durch deterministische Entscheidungslogik statt probabilistischer Interpretation.

Alle Entscheidungen sind reproduzierbar, erklärbar und revisionssicher – ohne KI-Raten, ohne Blackbox.

Das ist der Unterschied zwischen Tooling und einer semantischen Betriebsschicht.

Die semantische Plattform läuft clientseitig, weil sie dadurch ohne Backend-Overhead in beliebig viele Concerto-Shops ausrollbar ist, und weil sie DOM-Realität, Render-State und Live-Daten direkt dort liest, wo sie entstehen – im Browser.

Die Universal SEO Engine erzeugt für Produktseiten vollständig valide, konfliktfreie schema.org-Strukturen, die exakt dem entsprechen, was Google für Produktdarstellungen erwartet.

Dabei wird nicht einfach „irgendein“ Product-Schema ausgegeben, sondern die Engine prüft den tatsächlichen Seitentyp, die verfügbaren Daten und deren Konsistenz.

Nur wenn alle Voraussetzungen erfüllt sind, werden Produkt- und Offer-Schemas erzeugt und injiziert. Dadurch werden fehlerhafte oder widersprüchliche Rich Results vermieden.

Das Ergebnis sind stabile Google-Rankings, konsistente Rich Results und eine saubere, langfristig wartbare SEO-Struktur – auch bei grossen Sortimentsänderungen.

Viele Shops enthalten strukturierte Daten aus unterschiedlichen technologischen Generationen – etwa aus Core-Templates, Legacy-Themes oder historischen Erweiterungen. Dazu zählen insbesondere Microdata und RDFa, die direkt im HTML-Markup verankert sind.

Diese Technologien können clientseitig nicht zuverlässig entfernt werden, ohne tief in das DOM einzugreifen oder das Template-Risiko zu erhöhen.

Die Universal SEO Engine verfolgt daher einen bewusst anderen Ansatz: Sie publiziert ein sauberes, konsistentes JSON-LD, das von Google technologisch höher priorisiert wird als ältere Markup-Formate.

Bestehende Microdata- oder RDFa-Strukturen werden dadurch automatisch zurückgestellt, sofern keine inhaltlichen Widersprüche bestehen. Ein explizites Entfernen ist weder notwendig noch sinnvoll.

Ergebnis: klare Signale für Google durch moderne Schema-Technologie – auch in Shops mit historisch gewachsenem Markup.

Ein zentrales Merkmal der Universal SEO Engine ist die korrekte und regelkonforme Behandlung von Neu- und Refurbished-Produkten.

Die Engine erkennt den Produktzustand anhand klar definierter Status-Badges aus dem EPM und ordnet jedes Produkt eindeutig ein.

Diese Information wird korrekt und eindeutig

als itemCondition im Product-Schema ausgegeben.

Dadurch verstehen Suchmaschinen und KI-Systeme nicht nur, dass es sich um ein Produkt handelt, sondern auch in welchem Zustand es angeboten wird – ein entscheidender Faktor für Vertrauen, Vergleichbarkeit und Kaufentscheidungen.

Die Universal SEO Engine bildet reale Angebotssignale exakt so ab, wie sie im Webshop tatsächlich existieren – ohne Schätzungen, ohne Optimierungstricks und ohne Fantasie-Werte.

Ergebnis: Rich Results, die nicht „optimiert wirken“, sondern glaubwürdig, konsistent und regelkonform erscheinen – für Google ebenso wie für KI-Systeme.

Die Universal SEO Engine erkennt automatisch nicht-produktbezogene Seitentypen und strukturiert diese mit passenden Schema-Typen.

Jeder Seitentyp erhält ausschliesslich die passenden Schema.org-Typen – ohne Überschneidungen oder Konflikte.

Für jede einzelne Seite erzeugt die Universal LLM Engine ein eigenes, maschinenlesbares LLMDocument.

Dieses Dokument beschreibt nicht nur Texte oder Keywords, sondern macht für KI-Systeme eindeutig verständlich, worum es auf der Seite geht, welches Produkt, welches Thema oder welches Problem behandelt wird und in welchem fachlichen Kontext dies geschieht.

Im Gegensatz zu klassischer SEO wird hier nicht versucht, Inhalte „für Rankings zu optimieren“. Das LLMDocument ist bewusst nicht SEO-getrieben, sondern kontext-, bedeutungs- und relationsbasiert aufgebaut.

Dadurch müssen KI-Systeme nicht interpretieren oder raten, sondern können Inhalte strukturell verstehen.

Um Inhalte korrekt einzuordnen, nutzt die Universal LLM Engine eine klar definierte fachliche Ontologie.

Jede Seite wird thematisch verortet, z. Bsp. in den Bereichen Netzwerk, IT, Consumer oder Industrie.

Dadurch erkennt die KI nicht nur Inhalte, sondern auch Zusammenhänge, Abhängigkeiten und Anwendungsbezüge.

Durch strukturierte Aufbereitung werden Inhalte gezielt so vorbereitet, dass sie in AI-Suchergebnissen, Vergleichen und Empfehlungen korrekt, nachvollziehbar und bevorzugt verwendet werden können.

Concerto-Webshops werden damit für KI-Systeme zu einer verlässlichen Wissens- und Entscheidungsquelle – nicht nur zu weiteren Websites ohne Kontext.

Während klassische SEO dafür sorgt, gefunden zu werden, sorgt die Universal LLM Engine dafür, verstanden, eingeordnet und empfohlen zu werden.

Die Domain Ontology ist ein reines Knowledge-Modul: typed, nested, erklärbar. Sie erkennt Domänen wie networking, computing, printing, storage, smart_home, home_appliances, garden_outdoor und mehr – inklusive Prioritätsregeln.

Entscheidend: _meta ist docs-only, nicht scoring-relevant. Domain-Erkennung ist deterministisch (Treffer + strukturierte Signale).

Ergebnis: LLMs bekommen Kontext vor Interpretation – das reduziert Fehlzuordnungen massiv.

Der ProductType ist die zentrale Brücke zwischen Semantik und E-Commerce-Realität. Die ProductType Registry klassifiziert Seiten deterministisch, regelbasiert und erklärbar.

Die Entscheidung erfolgt mehrstufig: Eindeutige Signale greifen sofort, bei Mehrdeutigkeit kommt ein deterministisches Kandidaten-Scoring mit Confidence-Absicherung zum Einsatz.

Wird das Confidence Gate nicht erreicht, wird bewusst kein ProductType gesetzt.

Ergebnis: stabile Seitentypen, belastbare Scenario- & Intent-Ableitungen und keine Galaxy-, Accessory- oder Service-Fehlzuordnung.

Szenarien und Intents werden nicht aus Keywords geraten, sondern deterministisch aus dem ProductType abgeleitet. Damit wird aus “Text” ein belastbarer, maschinenlesbarer Nutzungskontext.

Das verhindert typische KI-Fehler (z. Bsp. USB-Hub ≠ Dockingstation, Garantie ≠ Hardware, Notebook-Schloss ≠ Tasche).

Mit dem Semantic Injection Layer (SIL) stellt die Universal LLM Engine zentrale Bedeutungsinformationen direkt im DOM bereit – explizit, strukturiert und maschinenlesbar.

Diese Daten sind keine Darstellung für Endnutzer, sondern eine zusätzliche Bedeutungsschicht für Suchmaschinen, KI-Systeme und interne Analyse.

Die Informationen ergänzen klassische SEO-Schemas um konkrete Bedeutung – dort, wo reines Markup oder Text an Grenzen stösst.

Der SASI-Core (Semantic Attribution & Signal Integrity) ist die zentrale Bewertungs- und Entscheidungsinstanz der Universal SEO & LLM Engine.

Er misst fortlaufend, wie stabil eine Seite für Maschinen interpretierbar ist – basierend auf der Übereinstimmung von DOM-Inhalt, SEO-Schemas und LLM-Interpretation.

Die daraus abgeleiteten SASI-Werte dienen gleichzeitig als Datengrundlage für das Semantic Insights Panel und als verbindliche Entscheidungsbasis für den Semantic Injection Layer.

Der SASI-Core selbst erzeugt keine Inhalte und nimmt keine Optimierungen vor. Er misst ausschliesslich Signalqualität, Konsistenz und Belastbarkeit.

Prinzip: messen, nicht verschönern.

Semantische Daten werden nur dann in den DOM injiziert, wenn die Seite für Maschinen stabil und konsistent interpretierbar ist.

Voraussetzungen (alle müssen erfüllt sein):

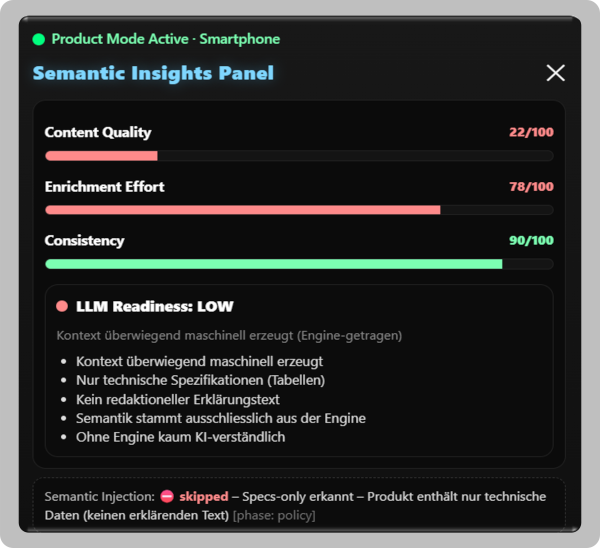

Ist eine dieser Bedingungen nicht erfüllt, wird keine Semantik injiziert.

Prinzip: lieber keine Semantik als falsche.

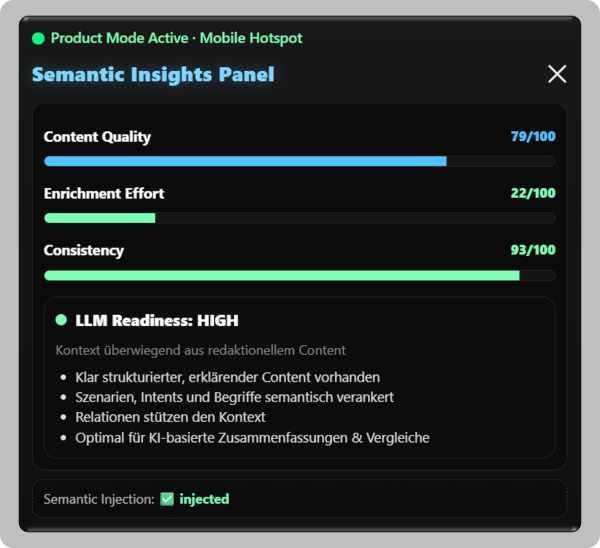

Das Semantic Insights Panel ist die zentrale Transparenz- und Kontrollschicht der Phoenix Universal SEO & LLM Engine. Es macht sichtbar, was das System erkennt, entscheidet und ausgibt – direkt auf der jeweiligen Seite, in Echtzeit.

Statt sich auf Annahmen oder externe Tools zu verlassen, sehen Betreiber, Entwickler und Agenturen hier die tatsächliche interne Sicht des Systems.

Zusätzlich zeigt das Semantic Insights Panel an, ob eine semantische Injektion stattgefunden hat oder bewusst unterdrückt wurde.

Diese Anzeige basiert direkt auf der SASI-Core-Entscheidung und spiegelt exakt wider, ob der Semantic Injection Layer aktiv war.

Das Semantic Insights Panel erlaubt es damit, Fehlinterpretationen sofort zu erkennen, SEO- und LLM-Logiken nachvollziehbar zu prüfen und sicherzustellen, dass Inhalte exakt so verstanden werden, wie sie gemeint sind.

SASI-Lite (Semantic Attribution & Signal Integrity) ist ein integrierter Monitoring-Layer, der sichtbar macht, wie stabil, konsistent und interpretierbar eine Seite für Suchmaschinen und KI-Systeme tatsächlich ist.

SASI-Lite ist kein Optimierungs-Score und kein Marketing-Indikator. Es bewertet nicht, wie „gut etwas aussieht“, sondern wie belastbar die zugrunde liegenden Signale sind, auf deren Basis Google und LLMs Entscheidungen treffen.

Die drei SASI-Dimensionen:

SASI-Lite ist bewusst nicht manipulierbar: reine Textmenge, Keywords oder isolierte Schemas verbessern die Werte nicht. Nur echte inhaltliche Substanz, saubere Struktur und konsistente Signale führen zu stabilen Ergebnissen.

Beispiele: SASI-Anzeigen im Semantic Insights Panel

Die angezeigten SASI-Werte stammen direkt aus dem SASI-Core, der die aktuelle Seite, die injizierten SEO-Schemas und das erzeugte LLM-Document fortlaufend analysiert. SASI-Lite macht diese Messwerte transparent sichtbar und dient als Frühwarn- und Diagnoseinstrument für strukturelle Schwächen, Thin-Content-Risiken oder inkonsistente Seitentypen.

Das Semantic Insights Panel ist ausschliesslich für interne Analysezwecke gedacht und wird nicht für Endkunden angezeigt.

Es ist nur sichtbar, wenn die Seite mit

?insights oder ?debug

aufgerufen wird.

Ohne diesen Parameter wird keinerlei zusätzlicher Code angezeigt oder ausgeführt. Das Panel hat keinen Einfluss auf Performance, SEO oder Nutzererlebnis.

Die Integration exklusiv in Concerto-Webshops erfolgt vollständig über ein einziges Widget – ohne Controller-Logik, ohne Kundengruppen und ohne Template-Overrides.

Für die Integration der Phoenix Universal SEO & LLM Engine wird im Concerto-Webshop-Admin ein neues HTML-Widget benötigt.

Lege das Widget unter Layout → Themes an und platziere es ganz oben im Header-Bereich, damit die Engine frühzeitig und seitenübergreifend geladen wird.

Trage den Widget-Titel im Feld „Zusätzliche Beschreibung“ ein, stelle den WYSIWYG-Editor auf „off“ und füge den Inhalt direkt im HTML-Feld ein.

Titel: 🤖 Universal SEO & LLM Engine

Inhalt:

<script src="https://ai.phoenix-ecoms.net/ai/phoenix-engines-loader.js"></script>

Die Phoenix Universal SEO & LLM Engine verfügt über einen zentralen, NAS-basierten License- & Domain-Check, der sicherstellt, dass das System ausschliesslich in autorisierten Concerto-Webshops ausgeführt wird.

Der Check erfolgt vollständig loaderseitig beim Initialisieren der Engine – noch bevor SEO- oder LLM-Logiken aktiv werden.

Der License-Check ist rein technisch implementiert und hat keinerlei Einfluss auf SEO, Performance oder Endkunden-Erlebnis.

Ergebnis: maximale Sicherheit, klare Mandantentrennung und eine revisionssichere Architektur für produktive Shops.

Die Freischaltung neuer Domains erfolgt ausschliesslich über den Administrator-Zugang auf dem NAS durch autorisierte Personen.

Wende dich für die Aufnahme einer neuen Shop-Domain in die Allowlist direkt an:

📧

[email protected]

☎️

+41 44 915 70 93

Hinweis: Die Freischaltung hat keinen Einfluss auf bestehende SEO-Daten, Performance oder den laufenden Betrieb des Webshops.

Nein. Es werden keine künstlichen Signale erzeugt. Keine Fake-Reviews, keine manipulativen Markups. Die Plattform sorgt für valide, konsistente und prüfbare Signale.

Im Normalbetrieb laufen nur die produktiven Module. Debug/Insights wird nur über ?insights oder ?debug aktiviert. Die Plattform ist auf Concerto-Webshop-Lösungen ausgelegt und bleibt clientseitig ohne Backend-Last.

Weil das ein Qualitätsmerkmal ist. Wenn Content spec-only / thin / inkonsistent ist, blockt die Policy bewusst. Prinzip: lieber keine Semantik als falsche Semantik.

Klassische SEO optimiert Sichtbarkeit. Diese Plattform optimiert Verständlichkeit – für Google und für LLMs – mit Explainability und Governance.

Ein zentrales Missverständnis moderner SEO-Strategien ist die Annahme, dass strukturierte Daten automatisch zu maschinellem Verständnis führen. Genau hier trennt die Phoenix Universal SEO & LLM Engine bewusst zwischen Markup und Bedeutung.

schema.org beschreibt Fakten: Preis, Verfügbarkeit, Name, Brand, Offer. Diese Informationen sind für Suchmaschinen notwendig, aber sie erklären nicht, warum ein Produkt existiert, wofür es eingesetzt wird oder welches Problem es löst.

Ein Product-Schema sagt: „Das ist ein Notebook.“ Es sagt aber nicht: „Dieses Notebook wird typischerweise im Homeoffice eingesetzt, löst Mobilitätsprobleme und ist relevant für Knowledge Worker.“

Für LLMs ist genau diese Bedeutungsebene entscheidend. Ohne sie müssen Modelle raten.

Das LLMDocument ist kein Ersatz für SEO-Schemas, sondern eine zusätzliche, explizite Bedeutungsschicht.

Es enthält:

Damit müssen KI-Systeme Inhalte nicht interpretieren, sondern können sie direkt verstehen.

Google benötigt schema.org, um Inhalte korrekt darzustellen. LLMs benötigen semantische Modelle, um Inhalte korrekt einzuordnen.

Die Phoenix Universal SEO & LLM Engine trennt diese beiden Ebenen bewusst, synchronisiert sie aber logisch über ProductType, Identifiers und SASI.

Ergebnis: Sichtbarkeit und Verständnis – ohne Kompromisse.

Die ProductType Registry ist der Dreh- und Angelpunkt für korrekte maschinelle Interpretation. Sie arbeitet regelbasiert, deterministisch und erklärbar – mit Score-basierter Kandidatenbewertung und einem klaren Confidence Gate. Ziel ist nicht eine erzwungene Entscheidung, sondern eine belastbare.

Der Begriff Galaxy beispielsweise ist semantisch ambig. Ohne Regeln entstehen Fehlklassifikationen: Smartphone-Zubehör wird als Smartphone oder Tablet interpretiert – oder umgekehrt.

Die Registry löst dieses Problem über:

Ergebnis: kein Smartphone-Schema auf Hüllen, keine Zubehör-Intents auf echten Devices.

In klassischen Systemen werden USB-Hubs häufig als Dockingstations interpretiert, weil beide ähnliche Keywords enthalten.

Die ProductType Registry unterscheidet explizit:

Diese Unterscheidung ist entscheidend für:

Garantie-Erweiterungen enthalten häufig Modellnamen, Serien oder Produktbezüge. Ohne harte Regeln werden sie als Hardware interpretiert.

Die Registry blockiert dies explizit:

Ergebnis: saubere Trennung von Produkt, Service und Zubehör.

Ein bewusstes Designprinzip der Plattform ist Transparenz. Wenn Semantik nicht injiziert wird, ist das kein Fehler – sondern eine erklärbare Entscheidung.

Der SASI-Core prüft jede Seite gegen eine feste Policy. Wird eine Bedingung nicht erfüllt, unterdrückt der Semantic Injection Layer die Ausgabe.

Typische Skip-Reasons:

Diese Reasons werden im Semantic Insights Panel explizit angezeigt.

Viele Systeme injizieren Semantik um jeden Preis. Das führt kurzfristig zu „mehr Daten“, langfristig aber zu Misstrauen bei Maschinen.

Die Phoenix Universal SEO & LLM Engine folgt dem Prinzip:

Lieber keine Semantik als falsche Semantik.

Genau das erhöht die langfristige Stabilität von Rankings, KI-Antworten und Empfehlungen.

Die Phoenix Universal SEO & LLM Engine ist kein kurzfristiges Optimierungswerkzeug, sondern eine Governance-Schicht für maschinelle Interpretation.

Moderne LLMs bewerten nicht nur Inhalte, sondern deren Konsistenz über Zeit.

Widersprüchliche Seitentypen, wechselnde Bedeutungen oder instabile Signale führen dazu, dass Inhalte seltener referenziert werden.

Die Plattform minimiert genau diese Risiken durch deterministische Entscheidungen und stabile Bedeutungsmodelle.

Jede Entscheidung der Engine ist erklärbar: ProductType, Szenarien, Intents, SASI-Scores und Skip-Reasons.

Das erlaubt Betreibern, Inhalte gezielt zu verbessern – nicht blind zu optimieren.

Ergebnis: echte Steuerbarkeit statt Hoffnung.

In einem persönlichen Gespräch zeigen wir dir, wie dein Concerto-Webshop mit der Phoenix Universal SEO & LLM Engine auf Google sichtbarer, von KI-Systemen korrekt verstanden und in KI-Antworten sowie Vergleichen bevorzugt berücksichtigt wird.

Du siehst konkret, wie strukturierte Schemas, semantische Modellierung und das Semantic Insights Panel zusammenspielen – und wie du jederzeit volle Kontrolle darüber hast, was Google und LLMs tatsächlich erkennen, interpretieren und ausspielen.

Das Erstgespräch ist kostenlos und unverbindlich und richtet sich an Betreiber und Entscheider aus dem Concerto-Ökosystem – Hersteller, Distributoren und Reseller, die verstehen und steuern wollen.

Kontakt:

📧

[email protected]

☎️

+41 44 915 70 93